A lógica por trás da nova patente da Microsoft — uma IA que assume temporariamente o controle para superar desafios — revela um conceito que pode ir além dos videogames e antecipar o surgimento de sistemas de combate assistidos por algoritmos no campo de batalha moderno.

Por Redação DefesaNet

Recentemente, uma patente registrada pela Microsoft chamou atenção no mundo dos games. A proposta descreve um sistema em que uma inteligência artificial pode assumir temporariamente o controle de um jogo para ajudar o jogador a superar um momento particularmente difícil — um chefe complexo, um quebra-cabeça complicado ou uma sequência de habilidade extrema.

À primeira vista, a ideia parece curiosa ou até polêmica dentro da cultura gamer, que valoriza a superação pessoal. Porém, analisada com atenção, essa patente revela algo mais profundo: um modelo de interação homem-máquina que pode ter paralelos diretos em sistemas militares modernos.

O conceito central é simples, mas poderoso.

O humano permanece no comando geral. Entretanto, quando a situação ultrapassa a capacidade de reação imediata do operador, a inteligência artificial intervém temporariamente para estabilizar o cenário.

Essa lógica já começa a aparecer em diversos domínios tecnológicos — inclusive no campo de batalha.

A lógica do “copiloto algorítmico”

O modelo sugerido pela patente da Microsoft pode ser descrito como um copiloto inteligente.

O fluxo seria algo como:

- o usuário controla o sistema normalmente

- a IA monitora constantemente o desempenho e o ambiente

- ao detectar dificuldade ou risco elevado, a IA oferece assistência

- o usuário pode autorizar a intervenção

- a IA executa a tarefa crítica

- o controle retorna ao humano

No universo dos games, isso pode significar derrotar um chefe de fase. No universo militar, pode significar sobreviver a um ataque de míssil ou reagir a uma emboscada. Essa diferença de escala é enorme, mas a lógica operacional é essencialmente a mesma.

A guerra moderna e o problema da velocidade

O campo de batalha contemporâneo enfrenta um problema central: a velocidade da decisão.

Sensores, radares, drones e sistemas eletrônicos produzem uma quantidade massiva de informações. Em muitos cenários, o operador humano simplesmente não consegue processar tudo a tempo.

Esse fenômeno é conhecido entre estrategistas como sobrecarga cognitiva do combatente.

Em situações críticas, segundos podem decidir o resultado de um combate.

Por isso, diversas forças armadas estão desenvolvendo sistemas em que a IA atua como um gestor automático de combate, assumindo funções em momentos específicos.

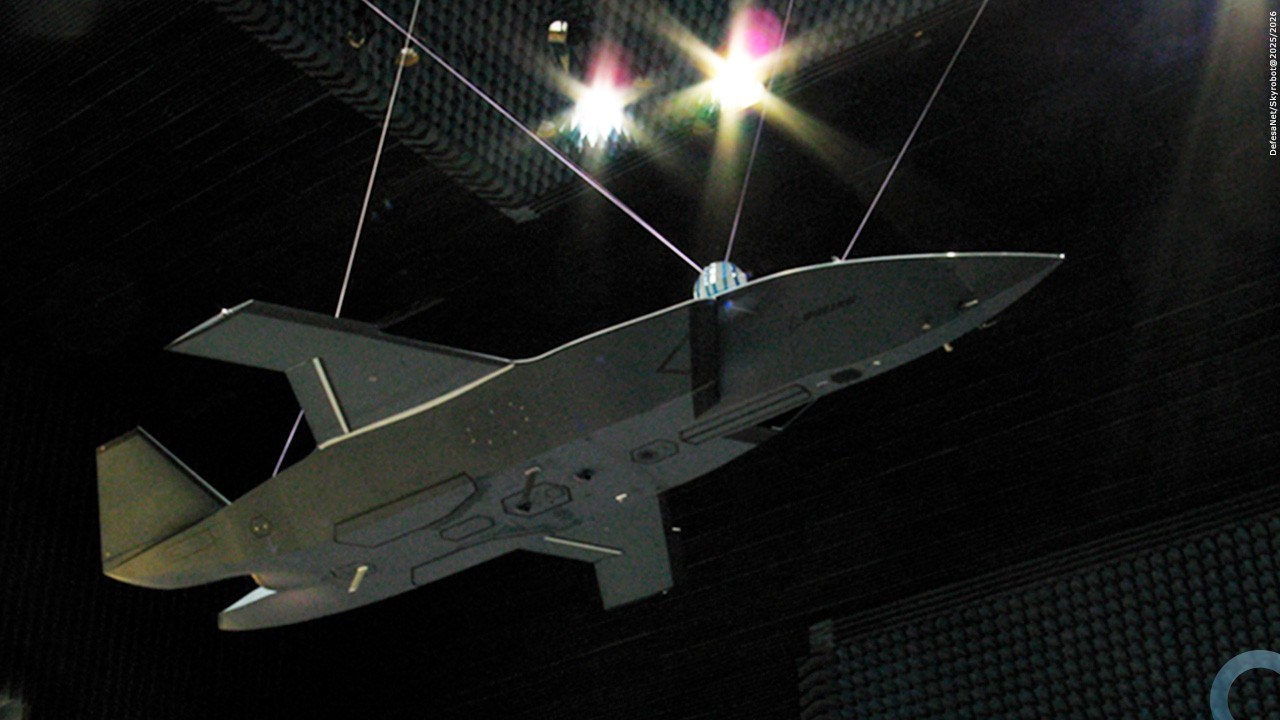

Um paralelo direto: aviação de combate

Na aviação militar moderna, já existem exemplos iniciais desse conceito.

Caças contemporâneos possuem sistemas capazes de:

- evitar automaticamente perda de controle

- impedir colisão com o solo

- priorizar alvos detectados por radar

- coordenar sensores e guerra eletrônica

Nos programas de caças de sexta geração, a tendência é que a IA evolua para algo muito mais sofisticado: um verdadeiro copiloto digital. Esse sistema poderá:

- analisar o espaço aéreo em tempo real

- sugerir táticas de combate

- coordenar drones acompanhantes

- executar manobras defensivas automáticas.

Em outras palavras, o piloto continuará sendo o comandante da missão, mas a IA atuará como um parceiro operacional extremamente rápido.

O caso dos sistemas de defesa automática

Alguns sistemas militares já operam com níveis elevados de automação. Defesas antimísseis e sistemas navais de curto alcance precisam reagir em frações de segundo. Nesses casos, a decisão humana muitas vezes é lenta demais.

Assim, sensores detectam a ameaça, algoritmos calculam a trajetória e o sistema executa a interceptação. O operador supervisiona, mas a máquina executa a ação crítica. Esse modelo é conhecido na doutrina militar como:

human-on-the-loop

O humano continua responsável pela missão, mas não executa cada micro decisão.

O dilema ético e estratégico

A ideia de uma máquina assumindo momentaneamente o controle levanta debates importantes.

Entre as principais preocupações estão:

- quem é responsável por uma decisão tomada pela IA

- até que ponto a autonomia deve ser permitida

- como evitar falhas ou decisões incorretas

Por outro lado, ignorar esse tipo de tecnologia pode significar uma desvantagem operacional significativa.

Em um ambiente onde sensores, drones e mísseis operam em velocidades cada vez maiores, a superioridade militar pode depender da capacidade de tomar decisões mais rápido que o adversário.

Do videogame ao campo de batalha

A patente da Microsoft pode parecer distante do mundo militar, mas ela ilustra um fenômeno maior: a normalização da cooperação entre humanos e inteligência artificial em tarefas complexas.

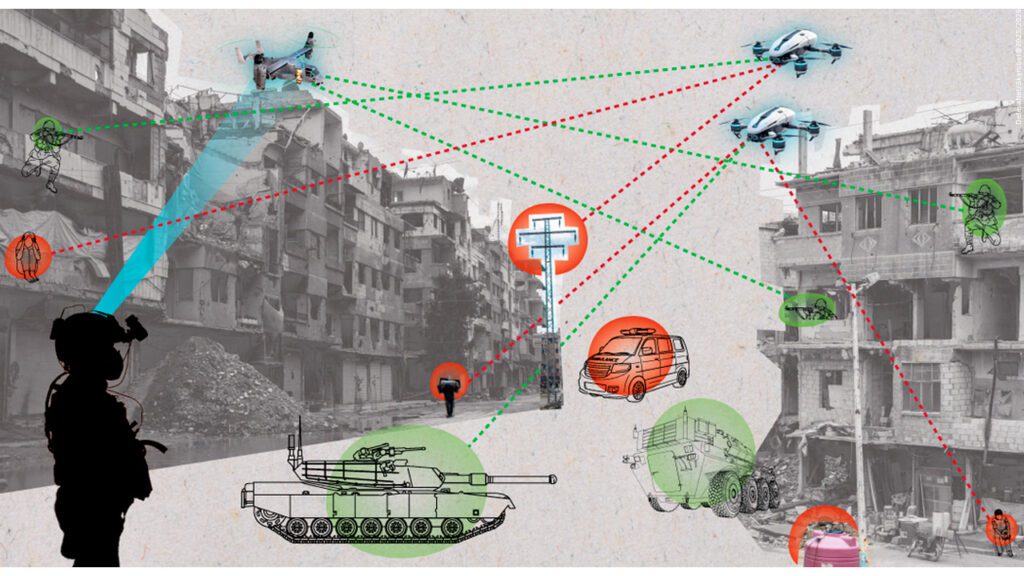

Nos videogames, a IA ajuda o jogador a superar um desafio. No campo de batalha, a IA pode ajudar um piloto, um comandante de blindado ou um operador de defesa aérea a sobreviver em um ambiente saturado de ameaças.

Em ambos os casos, a lógica é semelhante. Não se trata de substituir o humano. Trata-se de criar sistemas híbridos onde humanos e algoritmos dividem a tomada de decisão.

Quando a IA luta por você: o nascimento do combatente assistido por algoritmo

A patente registrada pela Microsoft, que prevê uma inteligência artificial capaz de assumir temporariamente o controle de um jogo para ajudar o jogador, revela um conceito que ultrapassa o entretenimento digital. Na essência, trata-se de um modelo operacional no qual a máquina intervém momentaneamente para resolver uma situação que excede a capacidade de reação humana.

Transposto para o campo militar, esse princípio aponta para o surgimento do que alguns analistas chamam de combatente assistido por algoritmo.

Nesse modelo, o soldado, piloto ou operador continua sendo o responsável pela missão. Contudo, sensores e sistemas de inteligência artificial monitoram continuamente o ambiente operacional. Quando o sistema identifica uma situação crítica — como um ataque iminente, uma ameaça inesperada ou uma saturação de informações — a IA pode assumir determinadas funções por alguns segundos, estabilizando o cenário até que o operador humano retome o controle pleno.

A lógica é semelhante ao que ocorre em sistemas modernos de aviação civil, onde proteções automáticas impedem o piloto de executar manobras que levariam a aeronave à perda de controle. No ambiente militar, porém, as implicações são mais profundas: a intervenção algorítmica pode significar evitar a destruição de um veículo, neutralizar uma ameaça ou preservar a vida da tripulação.

Esse conceito também está diretamente ligado à evolução da doutrina conhecida como human-on-the-loop, na qual o ser humano supervisiona sistemas autônomos capazes de executar determinadas ações em tempo real.

À medida que sensores, drones e armas de alta velocidade tornam o campo de batalha cada vez mais complexo, cresce a percepção entre estrategistas de que a vitória poderá depender da capacidade de combinar julgamento humano com a velocidade de decisão das máquinas.

Nesse cenário, a ideia de uma IA que “joga pelo usuário” deixa de parecer apenas uma curiosidade tecnológica. Ela passa a representar um vislumbre de como humanos e algoritmos poderão lutar lado a lado nos conflitos do futuro.

Conclusão

A patente da Microsoft revela mais do que uma curiosidade tecnológica para o mundo dos jogos. Ela simboliza uma transformação mais ampla na relação entre humanos e máquinas.

À medida que sistemas se tornam mais complexos e o tempo de reação diminui, a inteligência artificial tende a assumir um papel crescente como assistente decisório e operador de emergência.

Nos videogames, isso pode ajudar a vencer um chefe particularmente difícil.

Na guerra, pode significar algo muito mais sério:

a diferença entre sobreviver ou ser derrotado em um combate que se decide em segundos.

…